现状介绍 ¶

约 501 个字 1 张图片 预计阅读时间 2 分钟

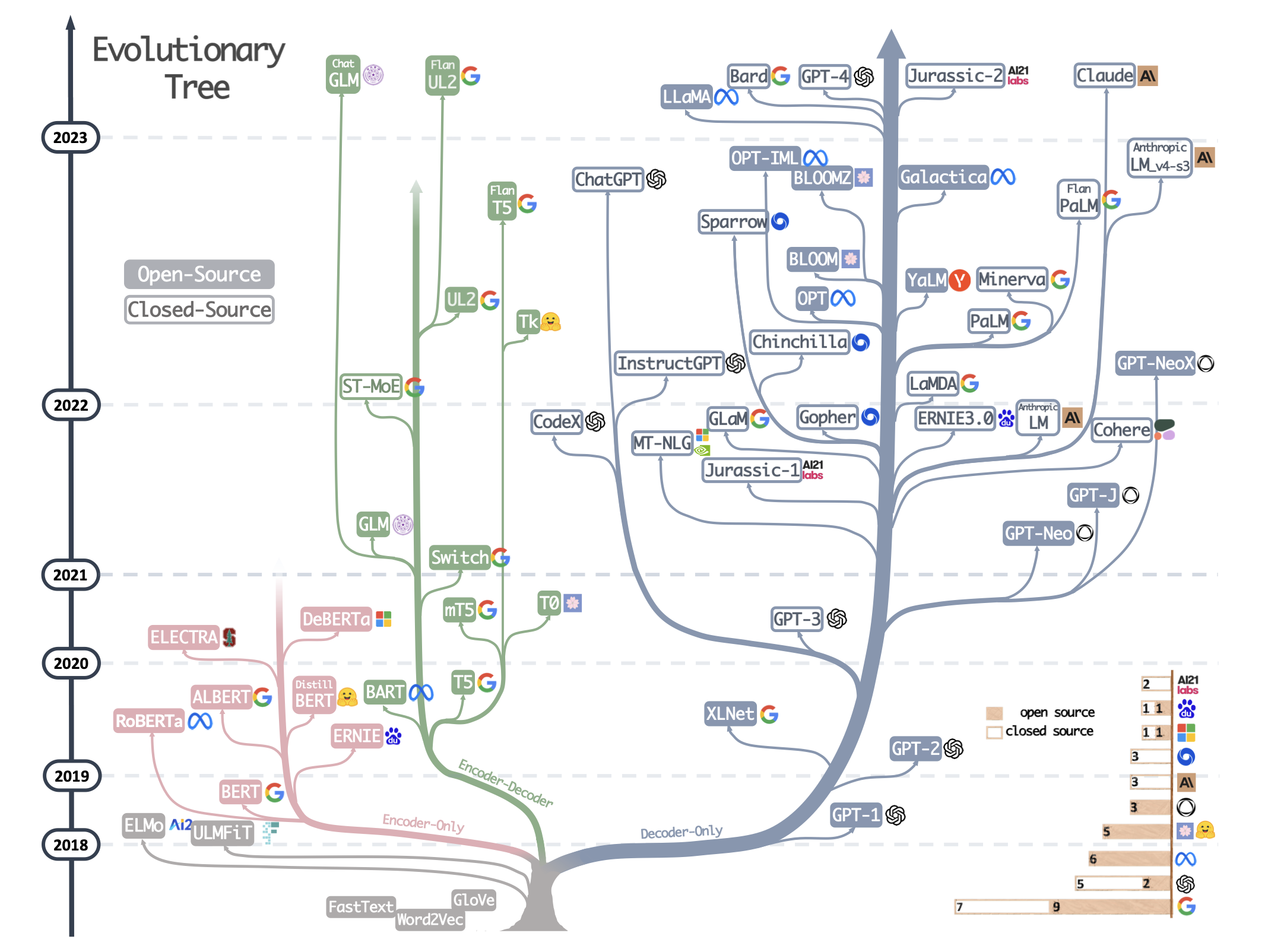

图源:Harnessing the Power of LLMs in Practice: A Survey on ChatGPT and Beyond

Transformer-based models are shown in non-grey colors: - decoder-only models in the blue branch - encoder-only models in the pink branch - encoder-decoder models in the green branch.

Keyword¶

涌现能力是啥原因?¶

涌现能力(Emergent Ability)是指模型在训练过程中突然表现出的新的、之前未曾预料到的能力。这种现象通常发生在大型模型中,原因是大型模型具有更高的表示能力和更多的参数,可以更好地捕捉数据中的模式和关联。随着模型规模的增加,它们能够自动学习到更复杂、更抽象的概念和规律,从而展现出涌现能力。

模型幻觉是什么?业内解决方案是什么?¶

模型幻觉是指模型在生成文本时产生的不准确、无关或虚构的信息。这通常发生在模型在缺乏足够信息的情况下进行推理或生成时。业内的解决方案包括: - 使用更多的数据和更高质量的训练数据来提高模型的泛化和准确性。 - 引入外部知识源,如知识库或事实检查工具,以提供额外的信息和支持。 - 强化模型的推理能力和逻辑推理,使其能够更好地处理复杂问题和避免幻觉。

基础 ¶

word2vec¶

tokenizer¶

网站与资源 ¶

目前主流的开源模型体系有哪些?¶

- Transformer 体系:由 Google 提出的 Transformer 模型及其变体,如 BERT、GPT 等。

- PyTorch Lightning:一个基于 PyTorch 的轻量级深度学习框架,用于快速原型设计和实验。

- TensorFlow Model Garden:TensorFlow 官方提供的一系列预训练模型和模型架构。

- Hugging Face Transformers:一个流行的开源库,提供了大量预训练模型和工具,用于 NLP 任务。